5 Prediksi Ancaman Siber Berbasis AI 2025, Harus Ekstra Waspada

- Penggunaan AI dan Large Language Models (LLMs) diprediksi akan digunakan oleh pelaku kejahatan siber untuk serangan phishing, vishing, SMS, dan rekayasa sosial.

- GenAI (Generative AI) berpotensi digunakan dalam pembuatan kit ransomware lengkap dengan sistem enkripsi otomatis, penargetan korban, dan pengintaian.

- Diprediksi muncul serangan malware yang dibuat dengan bantuan Generative AI dan media sosial menjadi tempat menyusup para pelaku kejahatan siber untuk membuat profile palsu.

Perkembangan teknologi Artificial Intelligence (AI) makin pesat dan mulai mengubah berbagai aspek kehidupan, termasuk dunia keamanan siber. Di balik manfaatnya dalam menciptakan sistem keamanan dan pendeteksian otomatis, AI kini juga mulai dimanfaatkan oleh para pelaku kejahatan siber untuk menciptakan serangan yang lebih canggih. Pada 2025 mendatang, AI diprediksi bakal jadi salah satu ancaman serius yang sulit buat dideteksi.

Bayangkan saja, serangan phishing yang terasa sangat personal atau malware yang bisa beradaptasi supaya lolos dari sistem keamanan bukan lagi imajinasi belaka. Belum lagi penipuan dengan memanfaatkan deepfake berbasis AI lewat suara atau video palsu yang terlihat sangat nyata. Gak cuma menargetkan individu, ancaman ini juga berpotensi besar menyerang perusahaan maupun lembaga negara yang memiliki data penting. Lalu, apa saja prediksi ancaman siber berbasis AI pada 2025 mendatang? Yuk, ketahui penjelasan lebih lengkapnya berikut biar bisa lebih waspada!

1. Serangan phising, vishing, dan rekayasa sosial yang lebih canggih

Menurut laporan Cybersecurity Forecast 2025 oleh Google Clouds, penggunaan AI dan Large Language Models (LLMs) diprediksi bakal makin berkembang digunakan oleh pelaku kejahatan siber untuk melakukan serangan phishing, vishing, SMS, dan rekayasa sosial. Ini bisa jadi salah satu ancaman yang sulit buat dideteksi karena kecanggihan AI dalam meniru pola komunikasi dan perilaku manusia yang perlahan semakin akurat.

Selain itu, penggunaan LLMs juga berpotensi membantu pelaku untuk mempercepat proses pembuatan dan penyebaran serangan dalam skala yang lebih besar. Lebih jauh lagi, teknologi ini juga mampu menciptakan serangan yang lebih terpersonalisasi sehingga membuat korban jadi rentan terkena penipuan. Langkah licik tersebut kemudian didukung dengan pemanfaatan deepfake untuk mencuri dan meniru identitas seseorang dengan sangat realistis.

2. Serangan ransomware dengan memanfaatkan teknologi GenAI

Melansir dari Palo Alto Networks, pada 2025 teknologi GenAI (Generative AI) diprediksi berpotensi digunakan dalam pembuatan kit ransomware yang lengkap dengan sistem enkripsi otomatis, penargetan korban, dan pengintaian. Teknologi ini memungkinkan pelaku untuk menciptakan agen AI yang bisa mengidentifikasi dan mengekploitasi kerentanan sistem enkripsi korban dengan lebih tepat sasaran. Serangan ini jadi ancaman serius karena lebih terpersonalisasi dan sulit untuk dideteksi oleh sistem keamanan yang ada.

Bahkan, ada kemungkinan chatbots juga bakal dimanfaatkan oleh pelaku kejahatan siber supaya lebih cepat dan mudah dalam melakukan negosiasi tebusan. Penggunaan chatbot ini bisa mempercepat proses komunikasi dengan korban, mempermudah pelaku untuk menekan korban supaya segera membayar, serta mengurangi risiko human error dalam menentukan jumlah tebusan. Tentunya ini membuat ancaman ransomware semakin berbahaya dan lebih sulit untuk dihentikan.

3. Serangan malware berbasis GenAI dan sistem AI multi-agen

Dilansir Devops Digest, diprediksi bakal muncul serangan malware yang dibuat dengan bantuan Generative AI. Teknologi ini memungkinkan pelaku kejahatan siber untuk menghasilkan kode malware yang lebih kompleks dan terarah hanya dengan satu perintah. Ini bisa mengurangi hambatan saat para pelaku meluncurkan serangan dan membuat ancaman jadi lebih sulit buat dideteksi oleh sistem keamanan tradisional.

Selain itu, juga diperkirakan bakal muncul sistem AI multi-agen, di mana beberapa model AI bekerja sama untuk menyelesaikan masalah yang kompleks. Bayangkan satu agen AI saja sudah cukup kuat buat melakukan serangan, apalagi jika beberapa agen AI ini berkolaborasi untuk merancang serangan yang lebih canggih dan terkoordinasi. Tentu ini bisa jadi ancaman yang sulit buat diatasi karena serangan dirancang untuk mengelabui sistem keamanan yang sudah dibangun.

4. Pemanfaatan deepfake AI untuk eksploitasi media sosial

Melansir dari Devops Digest, pada 2025 diprediksi media sosial dan GenAI bakal jadi kombinasi yang berbahaya. Kemampuan GenAI dalam menghasilkan konten palsu yang sangat realistis bisa dimanfaatkan oleh para penjahat siber untuk melakukan penipuan dengan lebih terstruktur. Teknologi deepfake AI ini bakal mereka gunakan buat mencuri identitas seseorang dan menduplikatnya dengan terlihat serealistis mungkin, termasuk suara, penampilan, bahkan perilaku sehari-hari.

Gak sampai di situ saja, media sosial juga berpotensi sebagai tempat menyusup para pelaku kejahatan siber untuk membuat profile palsu. Profil ini bisa digunakan untuk menyamar sekaligus berinteraksi dengan orang lain untuk tujuan penipuan dan pemerasan. Tentunya, hal ini bakal membingungkan banyak orang karena sulit buat membedakan antara interaksi yang asli dan yang dihasilkan oleh AI.

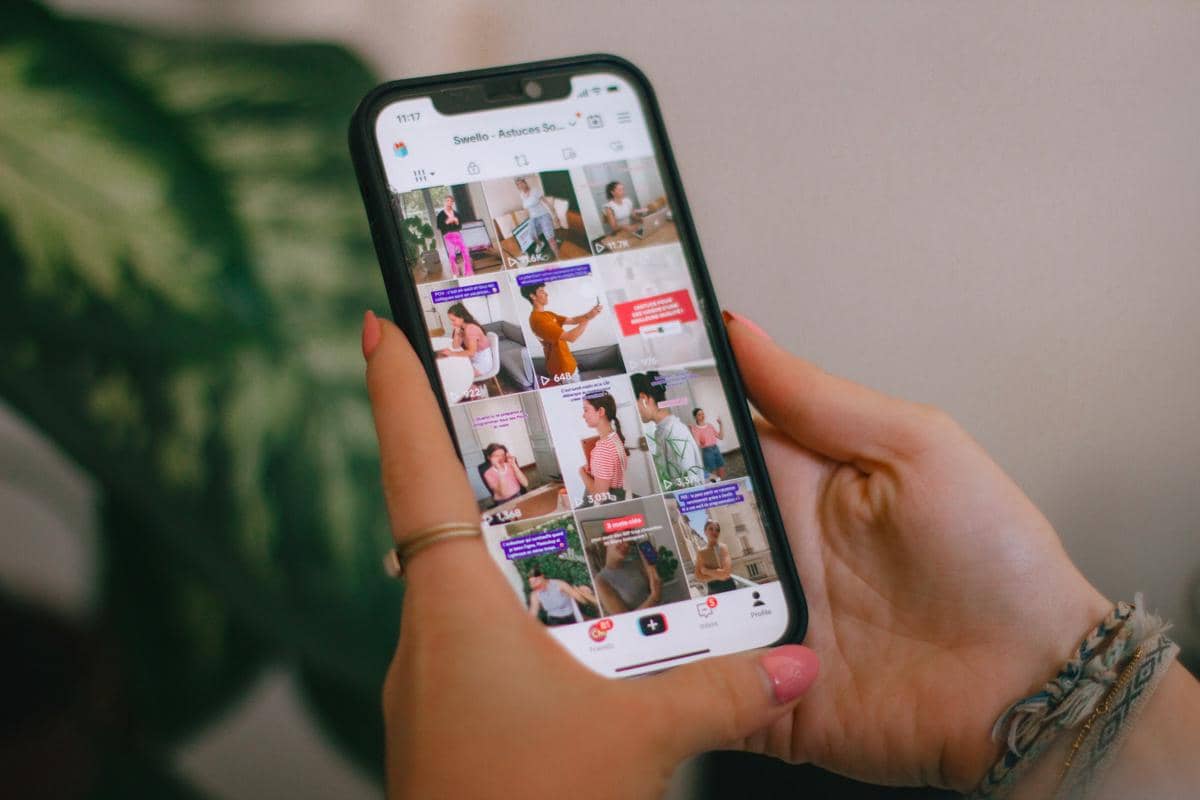

5. Ancaman keamanan data akibat oversharing saat menggunakan AI

Ancaman keamanan data akibat oversharing informasi saat menggunakan AI menjadi salah satu isu yang semakin mengkhawatirkan di dunia kerja. Berdasarkan laporan terbaru dari Oh, Behave!, sebanyak 52 persen karyawan ternyata gak mendapatkan pelatihan yang memadai soal cara menggunakan AI dengan aman. Tanpa pedoman penggunaan yang benar, banyak karyawan secara gak sadar sudah membocorkan data pribadi atau informasi sensitif yang seharusnya tetap dijaga kerahasiaannya.

Pada laporan tersebut juga diungkapkan bahwa sebanyak 38 persen karyawan membagikan informasi sensitif kepada AI tanpa sepengetahuan pemberi kerja mereka. Tindakan ini jelas bisa mengakibatkan kerugian besar, baik bagi individu maupun perusahaan karena data yang dibagikan tanpa kontrol bisa jatuh ke tangan yang salah. Ini berpotensi terjadinya pencurian data, penyalahgunaan informasi, atau bahkan serangan siber yang lebih besar.

Perkembangan teknologi AI yang pesat ternyata juga dibarengi dengan adanya ancaman keamanan siber. Teknologi seperti LLMs (Large Language Models), GenAI (Generative AI), deepfake, dan sistem AI multi-agen diprediksi bakal banyak digunakan oleh pelaku kejahatan siber buat melancarkan serangan yang lebih canggih dan sulit dideteksi. Untuk itu, yuk, kenali potensi ancaman ini supaya bisa selalu waspada dan menjaga data pribadi tetap aman!