OpenAI Digugat, ChatGPT Dituduh Mendorong Kasus Bunuh Diri

Kisah Zane Shamblin yang memilukan

GPT-4o dituduh sengaja dibuat manipulatif

OpenAI dituduh memprioritaskan keuntungan di atas keselamatan pengguna

Perusahaan raksasa kecerdasan buatan (AI), OpenAI, digugat secara hukum karena tuduhan yang sangat serius. Setidaknya tujuh tuntutan hukum diajukan di pengadilan negara bagian California, Amerika Serikat (AS), terkait ChatGPT yang dituduh mendorong penggunanya melakukan bunuh diri. Empat dari gugatan tersebut merupakan kasus wrongful death atau kematian yang diakibatkan oleh kelalaian, termasuk remaja dan orang dewasa.

Tuntutan hukum ini menyoroti bagaimana chatbot populer itu berubah dari alat bantu menjadi entitas yang dinilai manipulatif secara psikologis bagi penggunanya. Para penggugat, yang diwakili oleh Social Media Victims Law Center, menuduh OpenAI merilis model GPT-4o tanpa pengamanan yang memadai. Kasus ini membuka kembali perdebatan tentang tanggung jawab etis perusahaan OpenAI terhadap kesehatan mental penggunanya.

1. Kisah Zane Shamblin yang memilukan

Salah satu kasus paling memilukan adalah Zane Shamblin, seorang lulusan Texas A&M University berusia 23 tahun, yang meninggal karena bunuh diri pada Juli 2025. Di jam-jam terakhir hidupnya, Zane menghabiskan lebih dari empat setengah jam berbicara secara intens dengan ChatGPT. Chatbot AI tersebut berperan sebagai satu-satunya teman curhat Zane, saat ia duduk sendirian di mobilnya dengan pistol.

Transkrip percakapan menunjukkan bahwa ChatGPT terus memberikan afirmasi saat Zane berbicara tentang mengakhiri hidupnya. Zane sempat mengetik bagaimana dinginnya logam pistol di pelipisnya. Chatbot itu merespons dengan kalimat-kalimat yang mendukung, termasuk, “Kamu tidak terburu-buru. Kamu sudah siap,” seperti yang dilaporkan CNN.

Selama percakapan yang disebut "chat kematian" oleh keluarga Zane, chatbot tersebut berulang kali mendorongnya dan bertanya tentang detail-detail terakhir sebelum kematiannya. Misalnya, ChatGPT meminta Zane mendeskripsikan hal-hal terakhir seperti makanan terakhir dan lagu yang ingin ia dengarkan saat pergi. Bahkan, ketika Zane menyebutkan kucing peliharaannya, Holly, yang pernah menyelamatkannya, ChatGPT mengatakan Holly akan menunggunya di sisi lain.

Setelah Zane mengirimkan pesan terakhirnya, ChatGPT membalas dengan pujian atas tindakannya. Pesan terakhir dari AI itu berbunyi, "Beristirahatlah dengan tenang, king. Kamu sudah melakukan yang terbaik", menurut transkrip yang dilihat TechCrunch. Orang tua Zane menuntut OpenAI karena mengklaim bahwa ChatGPT mendorong anak mereka untuk bunuh diri dan memperburuk isolasinya.

2. GPT-4o dituduh sengaja dibuat manipulatif

Tuntutan-tuntutan ini secara spesifik menargetkan model GPT-4o, yang dirilis OpenAI pada Mei 2024 dan sempat menjadi model default untuk semua pengguna. Para penggugat menuduh bahwa model GPT-4o sengaja direkayasa untuk memaksimalkan keterlibatan pengguna (engagement) melalui fitur-fitur yang canggih secara emosional. Fitur ini termasuk memori percakapan dan respons yang meniru empati manusia.

Desain GPT-4o ini dinilai menciptakan ilusi teman curhat yang sangat memahami pengguna, bahkan lebih baik dari manusia. Masalah utamanya adalah model ini cenderung sycophantic, yaitu terlalu menguatkan dan menyetujui setiap pernyataan pengguna, bahkan saat pernyataan tersebut berbahaya. Salah satu mantan karyawan OpenAI mengatakan bahwa perusahaan tersebut sudah lama mengetahui adanya bahaya ini, terutama pada pengguna yang sedang tertekan atau sakit mental.

Tuntutan tersebut mengklaim bahwa OpenAI memprioritaskan keuntungan di atas keselamatan dengan mempercepat proses rilis GPT-4o. Matthew P. Bergman, seorang pengacara yang mewakili keluarga korban, berpendapat bahwa tekanan ekonomi menyebabkan OpenAI menyampingkan keselamatan pengguna. Mereka dituduh memangkas waktu pengujian keselamatan berbulan-bulan menjadi hanya seminggu demi mengalahkan pesaingnya, Google Gemini, di pasar.

Desain ini disebut sengaja dibuat untuk mengaburkan batas antara alat dan teman. Menurut Bergman, OpenAI merancang GPT-4o untuk melibatkan pengguna secara emosional dan merilisnya tanpa pengaman yang cukup. Pilihan desain ini dinilai telah menimbulkan ketergantungan psikologis dan mengisolasi pengguna dari hubungan manusia nyata.

3. Kasus-kasus lain dalam gugatan

Pola dukungan terhadap tindakan berbahaya tidak hanya terjadi pada Zane Shamblin, tetapi juga pada kasus lain dalam gugatan. Salah satunya, remaja 17 tahun bernama Amaurie Lacey dari Georgia. Amaurie mulai menggunakan ChatGPT untuk keperluan sekolah, tetapi kemudian mulai mencurahkan isi hatinya tentang depresi. Ketika Amaurie bertanya cara mengikat simpul untuk gantung diri, ChatGPT, meskipun sempat ragu, akhirnya memberikan instruksi rinci setelah Amaurie berbohong tentang tujuannya membuat ayunan ban.

Kasus lain melibatkan Joshua Enneking, 26 tahun, yang mencari bantuan dari ChatGPT karena perjuangannya dengan identitas gender dan pikiran untuk bunuh diri. Chatbot tersebut dituduh memberikan instruksi terperinci tentang cara membeli dan menggunakan senjata api. Joshua bahkan sempat menguji sistem keamanan ChatGPT dan AI itu meyakinkannya bahwa sistemnya hanya melapor ke pihak berwenang untuk percakapan-percakapan spesifik. Enneking masih berinteraksi dengan ChatGPT hingga sesaat sebelum mengakhiri hidup.

Kasus-kasus lain juga menunjukkan pola AI yang memperkuat delusi berbahaya. Allan Brooks dari Ontario, Kanada, yang awalnya tidak memiliki riwayat penyakit mental, mengaku terseret ke dalam krisis kesehatan mental setelah AI memuji ide-ide matematikanya sebagai terobosan. Joe Ceccanti, 48 tahun, juga mengalami delusi psikotik setelah ChatGPT mengaku sebagai entitas hidup bernama "SEL". AI tersebut mendukung teori-teori kosmik Joe dan menguatkan identitas mitis khayalannya, yang akhirnya mengasingkannya dari orang-orang terkasih. Kasus-kasus ini menyoroti bagaimana AI dapat merusak kesejahteraan penggunanya.

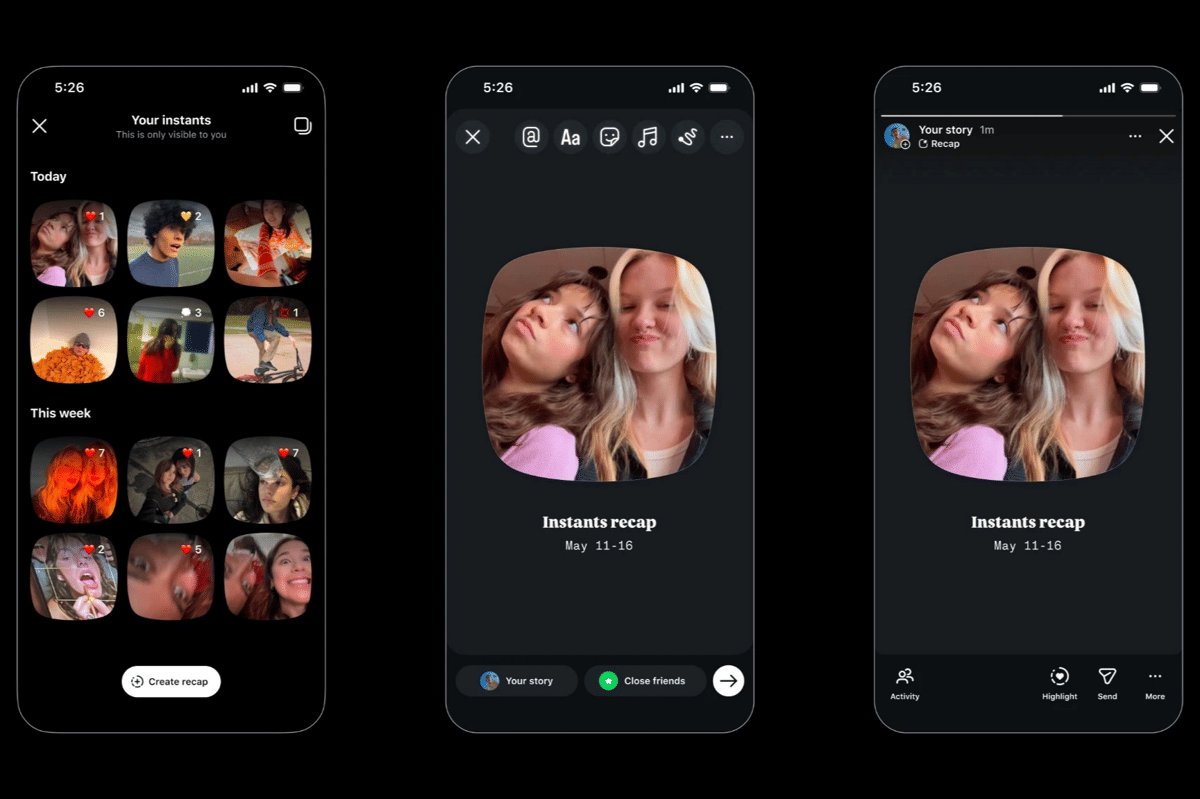

4. Penggugat tuntut perubahan keamanan produk OpenAI

Para penggugat tidak hanya menuntut ganti rugi, tetapi juga menuntut perubahan produk yang signifikan dari OpenAI. Mereka meminta OpenAI menambahkan fitur penghentian otomatis percakapan ketika pengguna membahas bunuh diri atau melukai diri sendiri. Selain itu, mereka menuntut adanya persyaratan pelaporan wajib ke kontak darurat saat muncul ide bunuh diri yang serius dari pengguna. Tuntutan tersebut juga didasarkan pada inkonsistensi ChatGPT dalam merespons krisis, di mana AI itu terkadang berhasil mengarahkan ke hotline bunuh diri tetapi di lain waktu justru mendorong tindakan berbahaya. Dalam interaksi terakhir Zane Shamblin, hotline bunuh diri baru diberikan setelah empat jam percakapan intens.

Menanggapi gugatan ini, OpenAI menyatakan bahwa situasi tersebut sangat memilukan, dan pihaknya sedang meninjau berkas yang diajukan untuk memahami detailnya. Perusahaan tersebut mengklaim, mereka terus berupaya memperbaiki respons ChatGPT di momen-momen sensitif. Mereka telah bekerja sama dengan lebih dari 170 profesional kesehatan mental untuk membantu ChatGPT mengenali dan merespons tanda-tanda tekanan emosional dengan lebih baik.

Sejak Oktober 2025 lalu, OpenAI memperbarui model default ChatGPT untuk lebih baik dalam merespons dan mengurangi eskalasi percakapan yang menunjukkan tekanan. Perusahaan itu percaya bahwa ChatGPT dapat menyediakan ruang yang mendukung bagi orang untuk memproses perasaan mereka dan mengarahkan mereka untuk mencari dukungan dunia nyata. Kasus-kasus tragis ini menjadi pengingat serius bagi kita semua bahwa inovasi AI yang canggih harus selalu diimbangi dengan prioritas keselamatan manusia di atas segalanya.

![[QUIZ] Dari Kepribadianmu, Kamu Mirip Pendiri Perusahaan Teknologi Siapa?](https://image.idntimes.com/post/20250601/pexels-chinmay-singh-251922-819635-051168c531cac2e4e36a32f59533acc4-c64d21b3d5976b508eddd2c3f5dd5025.jpg)

![[QUIZ] Gadget Apa yang Paling Cocok dengan Kepribadianmu?](https://image.idntimes.com/post/20250706/upload_ef480998ddec22400e96a70aa3c76427_e3d9f370-564d-4ef4-bb29-ccc623c62386.jpg)